데이터 표현 단위와 ASCII코드

비트(bit)

컴퓨터에서 표현할 수 있는 제일 작은 단위.

전기 스위치에서 on과 off만 존재하듯이

비트는 0(off)와 1(on)만 존재한다.

비트의 개수에 따라 표현할 수 있는 가짓 수가 늘어난다.

3비트라면, 23 = 8가지를 표현할 수 있다.

000, 001, 010, 100, 011, 101, 110, 111

바이트(Byte)

비트8개를 합쳐서 바이트로 표현한다.

문자를 표현하는 기본단위이다.

비트8개로는 28 = 256개의 경우의 수가 나온다.

ASCII라는 알파벳 문자 코드가 있는데, 한 문자의 크기를 8비트로 했기에

8비트(1바이트)가 데이터 기본단위가 되었다.

**ASCII코드는 뒤에 자세히 설명하겠습니다.

킬로바이트(KB)

1024바이트 = 1킬로바이트

1024바이트 = 8*1024 = 8192 = 28192의 수 만큼 표현가능.

메가바이트(MB)

1024KB = 1MB

기가바이트(GB)

1024MB = 1GB

테라바이트(TB)

1024GB = 1TB

페타바이트

1024TB = 1PB

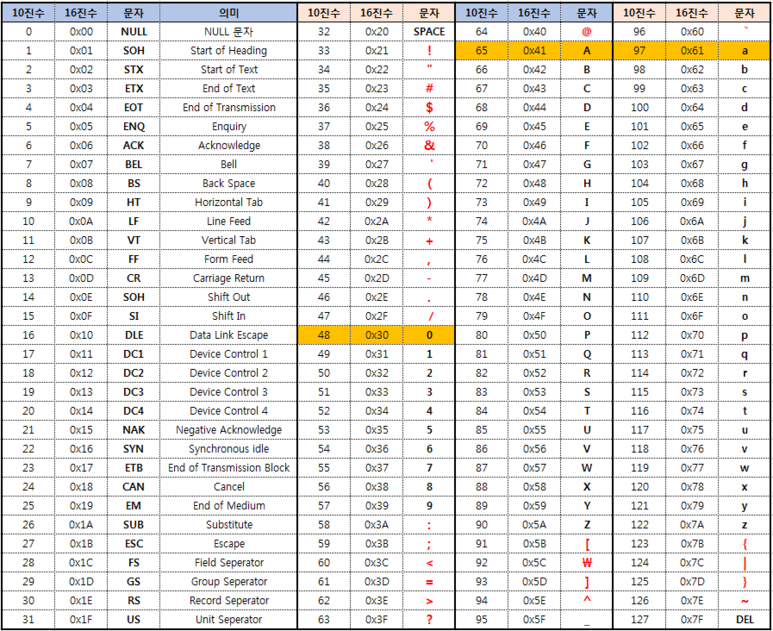

ASCII코드

미국표준협회에서 제시한 표준 코드 체계로, 문자를 표현하는 약속이다.

ASCII는 각 문자를 7비트로 표현한다.

7비트로 몇가지 문자를 만들 수 있을까? 27 =128가지이다.

하지만 이후에 표현해햐 할 문자가 더 많아지자,

기존 7비트에 1비트를 추가해서 8비트를 사용하도록 정의되었다.

기존의 7비트에는 가장 왼쪽에 0을 추가하도록 했다.

(=확장된 아스키코드. Extended ASCII)

따라서 현재 28 = 256개의 경우 중에

알파벳 대문자21 + 소문자21을 만들고,

나머지 214가지는 각종 특수문자들로 약속되었다.

아스키 코드 구조

아스키 코드 표

하지만 세상에는 알파벳만 있는게 아니고, 많은 언어들이 있다.

수 많은 언어들을 ASCII코드로 다 표현할 수 없기에 새로운 기술이 나왔다.

유니코드

아스키코드는 한 문자를 1Byte로 표현했는데,

유니코드는 한 문자를 1~4Byte로 표현한다.

이를 계산하면 256~ 42.9억까지 문자를 만들 수 있는 것이다.

한글은 이 유니코드로 인해 컴퓨터에 인식될 수 있다.